只要是線上游戲,玩家之間難免會有言語沖突,而國外知名電競游戲平臺FACEIT打造的全新AI 系統,將所謂的“機器學習”應用在這個地方。他們研發出一個AI系統,可以用來對付在線上對戰游戲中常常在聊天室口出惡言的玩家們。

FACEIT、Google Cloud與Jigsaw(前身為Google Labs)展開技術合作,一同打造了這個能夠偵測并且封鎖這些惡意玩家言論的AI,目前這個系統已經正式實裝,迄今為止,官方宣布他們已經封鎖了超過2萬位違規的《反恐精英:全球攻勢》(Counter-Strike: Global Offensive;CS:GO)玩家。

這個AI的名稱為“Minerva”,在經過了好幾個月的調整測試,將誤判率降到最低之后,該系統正式在今年8月于FACEIT自家電競游戲平臺中實裝。在那之后,這個AI寄出了9萬筆警告,并且封鎖了《CS:GO》2萬位在聊天室口出惡言或是洗頻的玩家,完全沒有經過人為手動介入。

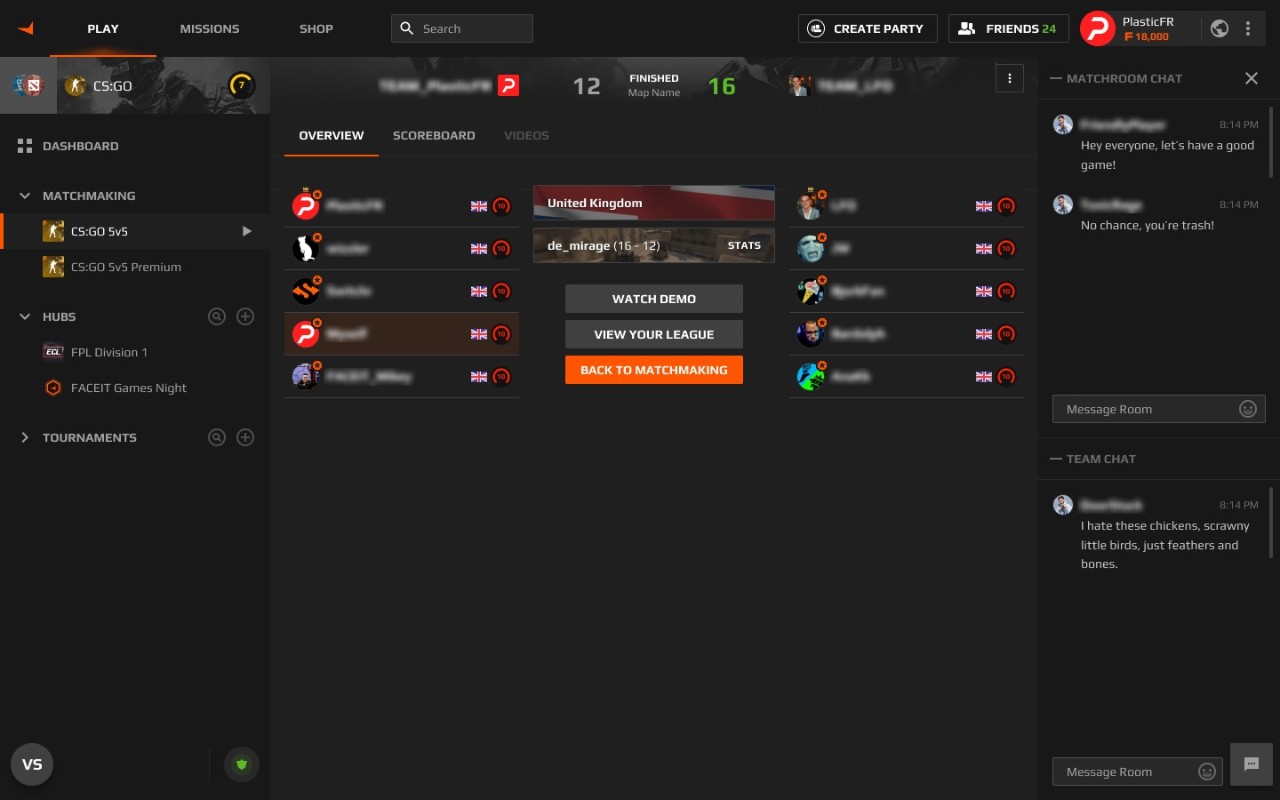

“如果一則信息在偵測了對話的前后文,并被判定為惡意言論之后,Minerva就會向該玩家發出『攻擊性言論』的警告。”FACEIT 在部落格貼文中解釋:“在聊天室中被判斷為垃圾信息的內容也一樣。Minerva在每場對戰結束后的幾秒內就能夠做出判斷,如果它偵測到了違規言論,系統就會自動發出警告,或是直接封鎖違規的玩家。”

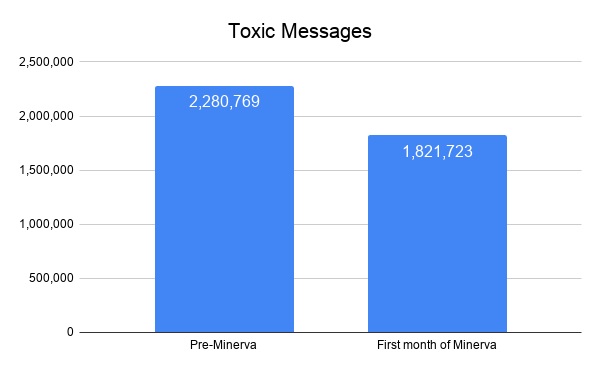

簡單來說,這個由FACEIT平臺與Google聯手打造的全新AI系統,在上線的一個月內已經封鎖了2萬位口出惡言的《CS:GO》玩家。而在這個AI實裝之后,在八月到九月這段期間內出現的惡意言論已經降低了20%左右,而會傳送這類言論的玩家數量也減少了8%。

“偵測游戲中的聊天室,對于Minerva來說只是最初也是最簡單的應用方式,也是一種個案研究法,這能夠作為我們對于這個AI的愿景所踏出的第一步。”

FACEIT在博客中表示:“我們對于目前的基礎都感到相當興奮,這也代表了一種能夠讓我們不斷改進Minerva的龐大基數,直到我們終于能夠瞬間偵測并處理任何形式的違規行為。而在接下來的幾周內,我們也會宣布全新的系統,借此用來支持Minerva的訓練。”